Der Netskope Threat Labs Manufacturing Report 2025 zeigt eine deutliche Zunahme generativer KI in der Industrie sowie neue Risiken durch Datenschutzverstöße und Malware-Verbreitung über Cloud-Anwendungen. Der Bericht analysiert Trends bei GenAI-Einführung, KI-Plattformen, API-Nutzung, Cloud-App-Aktivitäten und Compliance-Kontrollen und beleuchtet den Spagat zwischen Innovation und Datensicherheit.

-

GenAI-Nutzung: Die Akzeptanz generativer KI bleibt hoch. Während private Nutzung abnimmt, steigt der Einsatz unternehmensgenehmigter GenAI-Lösungen mit besseren Sicherheitsmechanismen.

-

Agentische KI: Firmen wechseln zunehmend von SaaS-Tools zu flexiblen, datenschutzorientierten GenAI-Plattformen, um eigene KI-Anwendungen zu entwickeln und mehr Kontrolle zu behalten.

-

GenAI-APIs: Die Nutzung von GenAI-APIs – etwa über api.openai.com – nimmt stark zu, insbesondere für interne Tools und KI-Agenten.

-

Malware-Verbreitung: Angreifer missbrauchen zunehmend Cloud-Dienste wie Microsoft OneDrive, GitHub und Google Drive zur Verteilung von Malware.

-

Cloud-App-Nutzung: Persönliche Cloud-Apps bleiben weit verbreitet und verwischen die Grenzen zwischen privaten und geschäftlichen Daten. Beliebt sind Google Drive, LinkedIn und OneDrive.

-

Datenschutzkontrollen: Unternehmen überwachen verstärkt Google Drive, Personal ChatGPT und Google Gemini, um Datenlecks über persönliche oder KI-basierte Apps zu verhindern.

-

Datenschutzverstöße: Die meisten Vorfälle betreffen regulierte Daten, geistiges Eigentum sowie Passwörter und API-Schlüssel, was den Schutz sensibler Informationen in unkontrollierten Umgebungen erschwert.

GenAI-Nutzung im Fertigungssektor: Trends und Akzeptanz

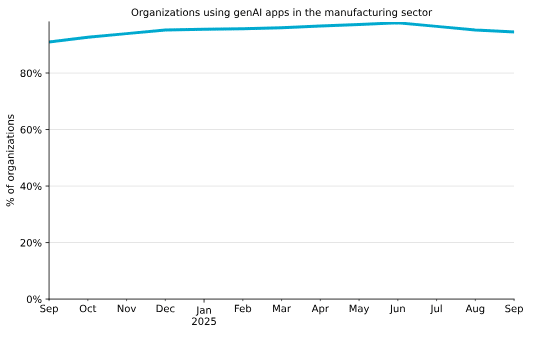

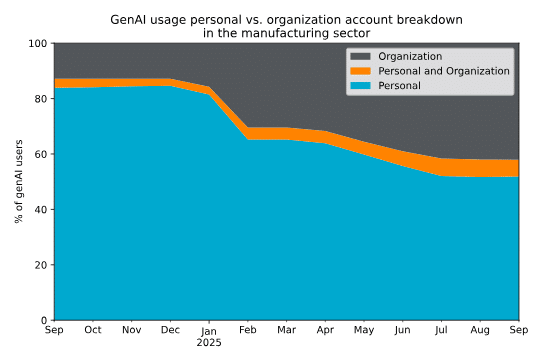

Die Nutzung von GenAI im Fertigungssektor bleibt hoch: 94 % der Organisationen setzen GenAI-Anwendungen direkt ein, 97 % nutzen Apps, die Daten für Modelltraining verwenden, und 96 % greifen indirekt auf GenAI-Tools zu. Persönliche Konten gingen von 83 % Ende 2024 auf 51 % im September 2025 zurück, während organisationsweit zugelassene Lösungen von 15 % auf 42 % stiegen – ein Zeichen für die zunehmende Präferenz sicherer, unternehmensgerechter Plattformen.

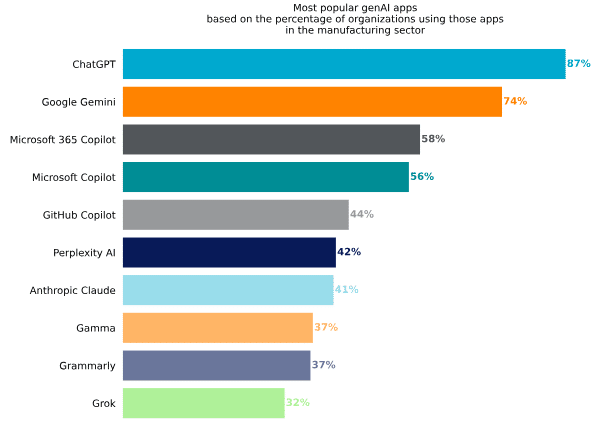

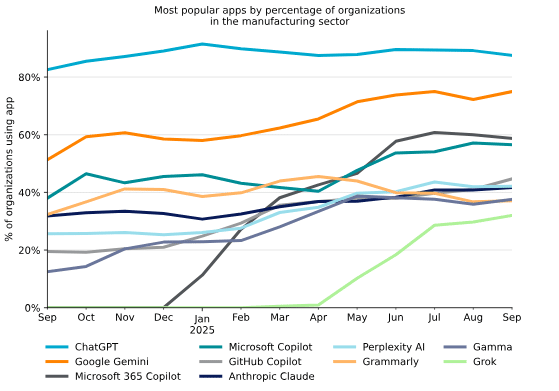

Die beliebtesten Anwendungen spiegeln globale Trends wider: ChatGPT führt mit 87 %, gefolgt von Google Gemini (74 %) und Microsoft 365 Copilot (58 %). Plattformen wie Grok gewinnen schnell an Bedeutung (0 % → 32 %). Der Fokus liegt zunehmend auf firmeneigenen Tools, die Datenschutz, Kontrolle und Workflow-Integration gewährleisten.

Datensicherheit und Datenschutzverstöße

Die Nutzung von GenAI für Dokumentenzusammenfassungen, Berichte oder Code-Optimierung birgt Datenschutzrisiken. Häufig betroffen sind regulierte Daten (29 %), Quellcode (28 %) sowie Passwörter/API-Schlüssel (26 %). Dies deckt sich mit globalen Trends und betont die Notwendigkeit stärkerer DLP-Kontrollen.

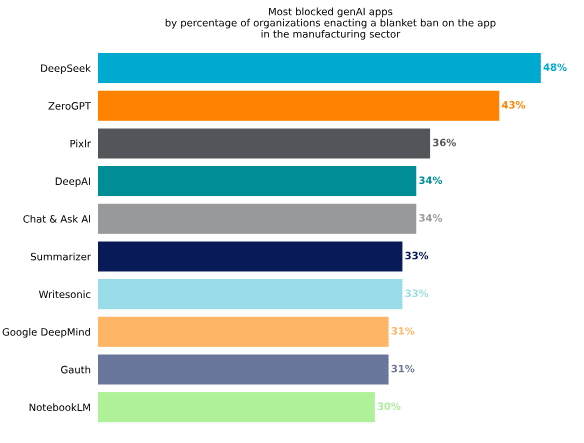

Die am häufigsten blockierten Apps sind DeepSeek (48 %) und ZeroGPT (43 %), da sie Transparenz- und Sicherheitsrisiken bergen. Unternehmen setzen zunehmend auf unternehmenseigene GenAI-Plattformen wie OpenAI über Azure (37 %), Amazon Bedrock (31 %) und Google Vertex AI (7,8 %), um Modelle privat zu hosten und maßgeschneiderte Lösungen zu entwickeln.

API-Nutzung und Cloud-Anwendungen

GenAI-Agenten greifen meist über APIs auf Cloud-Modelle zu. OpenAI dominiert hier (67 %), gefolgt von AssemblyAI (59 %) und Anthropic (24 %).

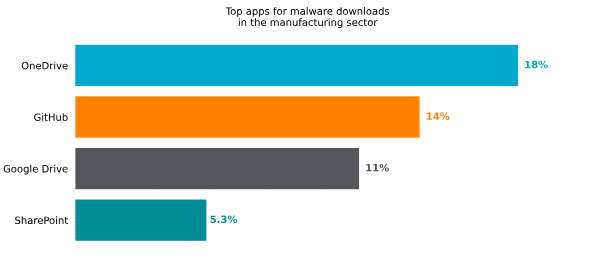

Cloud-Dienste bergen jedoch Malware-Risiken: 22 von 10.000 Nutzern stoßen monatlich auf schädliche Inhalte. Häufig betroffen sind OneDrive (18 %), GitHub (14 %) und Google Drive (11 %).

Auch persönliche Cloud-Apps sind weit verbreitet: Google Drive (98 %), LinkedIn (95 %) und OneDrive (94 %). Sie erhöhen das Risiko unbeabsichtigter Datenoffenlegung. Um dem entgegenzuwirken, implementieren Unternehmen DLP-Maßnahmen: Google Drive (35 %), persönliche ChatGPT-Konten (29 %) und Google Gemini (23 %) werden aktiv überwacht.

Datenschutzverstöße betreffen vor allem regulierte Daten (41 %), geistiges Eigentum (32 %), Passwörter/API-Schlüssel (19 %) und Quellcode (8 %). Im Gegensatz zu globalen Trends ist hier Quellcode weniger betroffen, was die spezifischen Risiken des Fertigungssektors verdeutlicht.

Empfehlungen für GenAI- und Cloud-Sicherheit

-

Downloads überwachen: Alle HTTP/HTTPS-Downloads prüfen, um Malware zu blockieren.

-

Apps kontrollieren: Nur vertrauenswürdige Anwendungen zulassen, riskante blockieren.

-

Daten schützen: DLP einsetzen, um sensible Informationen vor unautorisierten Apps oder Speicherorten zu sichern.

-

Sichere Webnutzung: Remote Browser Isolation für risikobehaftete Websites nutzen.

Quelle aller Grafiken: Netskope

Das sollten Sie sich ansehen:

Bild/Quelle: https://depositphotos.com/de/home.html

Fachartikel

Cyberangriffe auf Verteidigungsunternehmen: Wie Geheimdienste und Hacker die Rüstungsindustrie infiltrieren

UNC1069: Nordkoreanische Hacker setzen auf KI-gestützte Angriffe gegen Finanzbranche

KI-gestütztes Programmieren bedroht Open-Source-Ökosystem

Einfache Trainingsabfrage hebelt Sicherheit von 15 KI-Modellen aus

Künstliche Intelligenz verstärkt Arbeitsbelastung statt sie zu verringern

Studien

Deutsche Wirtschaft unzureichend auf hybride Bedrohungen vorbereitet

Cyberkriminalität im Dark Web: Wie KI-Systeme Betrüger ausbremsen

Sicherheitsstudie 2026: Menschliche Faktoren übertreffen KI-Risiken

Studie: Unternehmen müssen ihre DNS- und IP-Management-Strukturen für das KI-Zeitalter neu denken

Deutsche Unicorn-Gründer bevorzugen zunehmend den Standort Deutschland

Whitepaper

Token Exchange: Sichere Authentifizierung über Identity-Provider-Grenzen

KI-Agenten in Unternehmen: Governance-Lücken als Sicherheitsrisiko

KuppingerCole legt Forschungsagenda für IAM und Cybersecurity 2026 vor

IT-Budgets 2026 im Fokus: Wie Unternehmen 27 % Cloud-Kosten einsparen können

DigiCert veröffentlicht RADAR-Bericht für Q4 2025

Hamsterrad-Rebell

KI‑basierte E‑Mail‑Angriffe: Einfach gestartet, kaum zu stoppen

NIS2: „Zum Glück gezwungen“ – mit OKR-basiertem Vorgehen zum nachhaltigen Erfolg

Cyberversicherung ohne Datenbasis? Warum CIOs und CISOs jetzt auf quantifizierbare Risikomodelle setzen müssen

Identity Security Posture Management (ISPM): Rettung oder Hype?