Chancen und Risiken von Künstlicher Intelligenz + Künstliche Intelligenz (KI) wird künftig die Sicherheit von IT-Systemen verbessern. In den Händen von Cyberkriminellen öffnet sie andererseits auch Einfallstore für neue Bedrohungen der IT-Sicherheit. Auch die KI-Systeme selbst müssen vor Manipulation geschützt werden. Die Dynamik zwischen IT-Sicherheit und KI analysiert das Whitepaper “Künstliche Intelligenz und IT-Sicherheit”, das die Plattform Lernende Systeme zur Hannover Messe 2019 veröffentlicht. Die Autorinnen und Autoren aus Wirtschaft, Wissenschaft und Behörden fordern, insbesondere kleine und mittlere Unternehmen sowie IT-Fachkräfte beim Aufbau von Kompetenzen zu unterstützen.

Die Vernetzung im Zuge der Digitalisierung macht Unternehmen, öffentliche Institutionen und Smart Homes zunehmend verwundbar durch Cyberangriffe. KI-Systeme unterstützen IT-Fachkräfte künftig dabei, Sicherheitslücken aufzuspüren, Angriffe schneller zu erkennen und abzuwehren sowie die Identität von Personen sicherzustellen – etwa durch Erkennung von Sprache oder nutzerspezifische Tastatureingaben. Die Autoren des Whitepapers der Plattform Lernende Systeme betonen jedoch, dass die letzte Entscheidungsinstanz immer der Mensch sein müsse. So können KI-Systeme den Fachkräftemangel im Bereich IT-Sicherheit zwar milden, indem sie Routineaufgaben zur Prüfung der IT-Sicherheit übernehmen, menschliche Spezialisten aber nie ersetzen.

„Zwischen Angreifern und Verteidigern der IT-Sicherheit entfacht die KI einen neuen Wettlauf. Unternehmen und Behörden müssen deshalb rasch entsprechende Kompetenzen aufbauen und in neue Technologien investieren. Auch die Ausbildung von IT-Fachkräften muss angepasst werden, um den Angreifern weiterhin einen Schritt voraus zu bleiben“, fordert Jörn-Müller Quade, Leiter der Arbeitsgruppe „IT-Sicherheit, Privacy, Recht und Ethik“ der Plattform Lernende Systeme und Inhaber des Lehrstuhls für Kryptographie und Sicherheit am Karlsruher Institut für Technologie (KIT).

KI gibt auch den Angreifern neue Werkzeuge an die Hand, um Schwachstellen in IT-Systemen zu finden, ihre Schadprogramme zu optimieren und Authentifizierungsverfahren zu unterlaufen – indem sie beispielsweise Tippmuster imitieren. Besonders Social Engineering könnte zum Massenphänomen werden, also Angriffe, bei denen Menschen so getäuscht werden, dass sie dem Angreifer freiwillig Passwörter oder Bankdaten verraten. Benötigt man bislang Menschenkenntnis und Hintergrundwissen, um beispielsweise eine Phishing-Mail an den Stil des Absenders anzupassen und so zu tarnen, können KI-Systeme künftig hocheffizient online verfügbare Informationen sammeln, um etwa eine E-Mail auf die Zielperson einer Attacke zuzuschneiden.

Auch KI-Systeme selbst können künftig Ziel von Hackern sein. Sensible Daten, beispielsweise in der Gesundheitsversorgung, gilt es vor Missbrauch zu schützen. Ebenso könnten Daten, die lernende Algorithmen verarbeiten, manipuliert werden. Dies kann zum Beispiel die Vorhersagen von KI-Anwendungen im Wertpapierhandel verfälschen oder autonome Fahrzeuge zu Fehlentscheidungen verleiten. Datenschutzerhaltende Lernalgorithmen und die Resilienz von KI-Systemen gegen Manipulation müssen deshalb noch intensiver erforscht werden.

Das Whitepaper „KI und IT-Sicherheit“ wurde von Expertinnen und Experten der interdisziplinären Arbeitsgruppe „IT-Sicherheit, Privacy, Recht und Ethik“ der Plattform Lernende Systeme verfasst und steht nunmehr zum Download zur Verfügung.

https://www.plattform-lernende-systeme.de/files/Downloads/Publikationen/20190403_Whitepaper_AG3_final.pdf

https://www.plattform-lernende-systeme.de/home.html

Fachartikel

Studien

Drei Viertel aller DACH-Unternehmen haben jetzt CISOs – nur wird diese Rolle oft noch missverstanden

AI-Security-Report 2024 verdeutlicht: Deutsche Unternehmen sind mit Cybersecurity-Markt überfordert

Cloud-Transformation & GRC: Die Wolkendecke wird zur Superzelle

Threat Report: Anstieg der Ransomware-Vorfälle durch ERP-Kompromittierung um 400 %

Studie zu PKI und Post-Quanten-Kryptographie verdeutlicht wachsenden Bedarf an digitalem Vertrauen bei DACH-Organisationen

Whitepaper

Unter4Ohren

Datenklassifizierung: Sicherheit, Konformität und Kontrolle

Die Rolle der KI in der IT-Sicherheit

CrowdStrike Global Threat Report 2024 – Einblicke in die aktuelle Bedrohungslandschaft

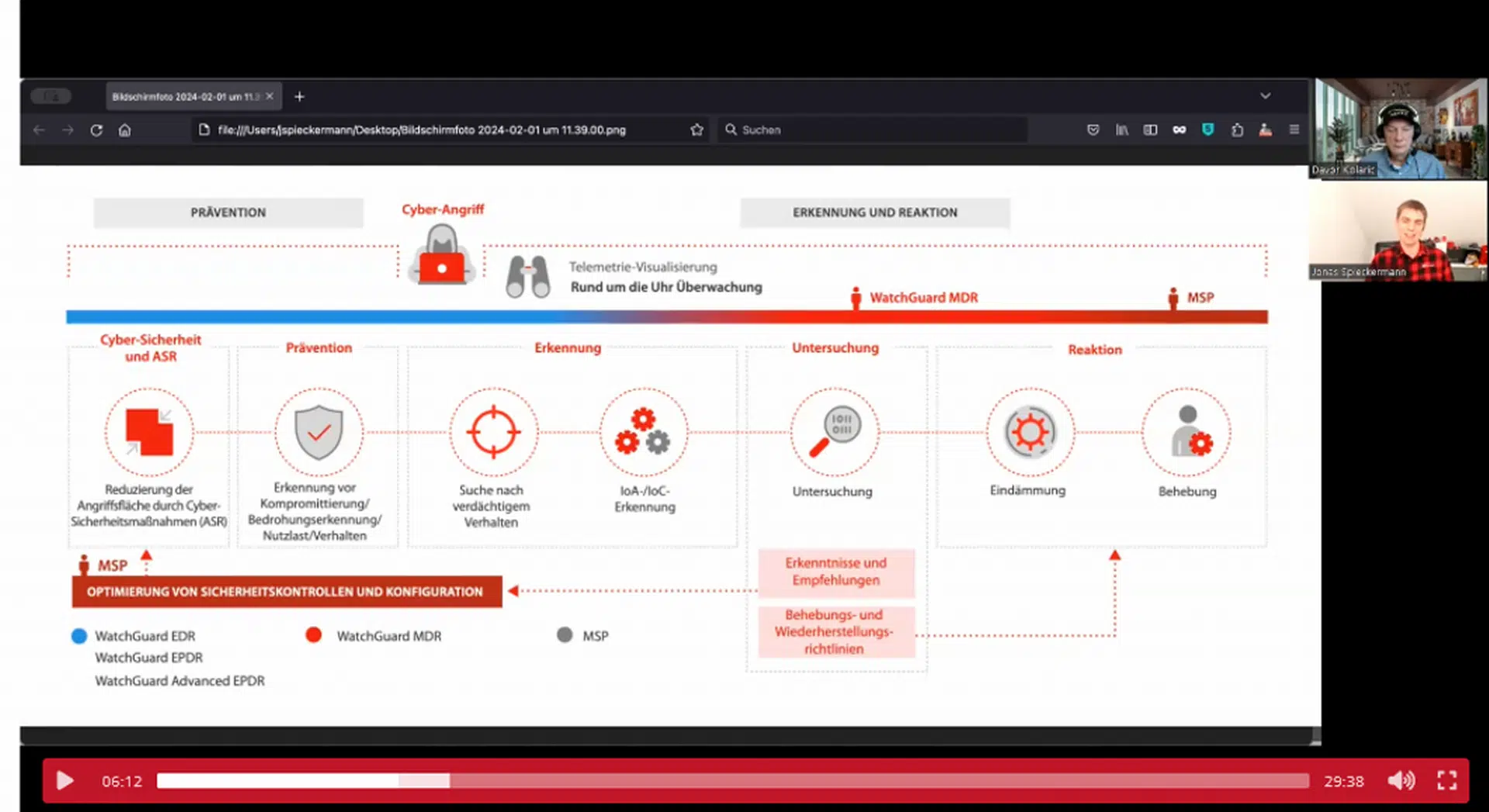

WatchGuard Managed Detection & Response – Erkennung und Reaktion rund um die Uhr ohne Mehraufwand