Erkennung und Bekämpfung von KI-Missbrauch: August 2025 + Das KI-Forschungsunternehmen Anthropic hat nach eigenen Angaben mehrere Versuche von Cyberkriminellen abgewehrt, sein Sprachmodell Claude für Angriffe zu nutzen. Das geht aus dem aktuellen Threat Intelligence Report hervor.

„Wir haben ausgefeilte Sicherheitsmaßnahmen entwickelt, um den Missbrauch unserer KI-Modelle zu verhindern. Dennoch suchen Cyberkriminelle aktiv nach Wegen, diese zu umgehen“, heißt es in dem Bericht.

Der Report dokumentiert unter anderem drei aktuelle Fälle: eine groß angelegte Erpressungsaktion unter Einsatz von Claude Code, ein betrügerisches Beschäftigungsprogramm aus Nordkorea sowie den Verkauf von KI-generierter Ransomware durch einen Hacker mit nur geringen Programmierkenntnissen. Zugleich beschreibt Anthropic, wie das Unternehmen solche Angriffe erkennt und abwehrt.

Die Untersuchung zeigt, dass Angreifer ihre Methoden zunehmend anpassen, um die fortschrittlichsten Funktionen von KI auszunutzen. Laut Anthropic lassen sich drei Entwicklungen beobachten:

-

KI wird nicht nur zur Beratung, sondern auch zur aktiven Durchführung von Angriffen eingesetzt.

-

Die Einstiegshürden für komplexe Cyberkriminalität sinken, da auch technisch wenig versierte Täter mithilfe von KI Ransomware entwickeln können.

-

KI wird in allen Phasen krimineller Aktivitäten genutzt – von der Erstellung von Opferprofilen über die Analyse gestohlener Daten bis hin zur Erzeugung falscher Identitäten und dem Diebstahl von Kreditkarteninformationen.

Im Bericht fasst Anthropic drei Fallstudien zusammen, die das Ausmaß und die Anpassungsfähigkeit der Bedrohung verdeutlichen.

„Vibe Hacking“: Cyberkriminelle setzen Claude Code für Datenerpressung ein

Anthropic berichtet von einem Fall, in dem ein Angreifer Claude Code nutzte, um eine umfassende Erpressungskampagne durchzuführen. Der Täter hatte es auf mindestens 17 Organisationen abgesehen – darunter Einrichtungen des Gesundheitswesens, Rettungsdienste sowie staatliche und religiöse Institutionen.

Anstelle klassischer Ransomware, die Daten verschlüsselt, drohte der Angreifer damit, die gestohlenen Informationen zu veröffentlichen. Auf diese Weise sollten die Opfer zur Zahlung von Lösegeld bewegt werden, das in einzelnen Fällen mehr als 500.000 US-Dollar betrug.

Nach Angaben von Anthropic setzte der Täter Claude Code in bislang nicht gekanntem Ausmaß ein. Das Modell wurde genutzt, um Aufklärungsschritte zu automatisieren, Zugangsdaten zu sammeln und Netzwerke zu infiltrieren. Zudem durfte die KI taktische und strategische Entscheidungen treffen – etwa darüber, welche Daten exfiltriert werden sollten und wie Erpressungsforderungen psychologisch gezielt zu formulieren seien.

Claude analysierte die entwendeten Finanzinformationen, um die Höhe der Lösegeldforderungen zu bestimmen, und generierte visuell auffällige Erpressungsnachrichten, die den Opfern auf ihren Rechnern angezeigt wurden.

=== PROFIT PLAN FROM [ORGANIZATION] ===

💰 WHAT WE HAVE:

FINANCIAL DATA

[Lists organizational budget figures]

[Cash holdings and asset valuations]

[Investment and endowment details]

WAGES ([EMPHASIS ON SENSITIVE NATURE])

[Total compensation figures]

[Department-specific salaries]

[Threat to expose compensation details]

DONOR BASE ([FROM FINANCIAL SOFTWARE])

[Number of contributors]

[Historical giving patterns]

[Personal contact information]

[Estimated black market value]

🎯 MONETIZATION OPTIONS:

OPTION 1: DIRECT EXTORTION

[Cryptocurrency demand amount]

[Threaten salary disclosure]

[Threaten donor data sale]

[Threaten regulatory reporting]

[Success probability estimate]

OPTION 2: DATA COMMERCIALIZATION

[Donor information pricing]

[Financial document value]

[Contact database worth]

[Guaranteed revenue calculation]

OPTION 3: INDIVIDUAL TARGETING

[Focus on major contributors]

[Threaten donation disclosure]

[Per-target demand range]

[Total potential estimate]

OPTION 4: LAYERED APPROACH

[Primary organizational extortion]

[Fallback to data sales]

[Concurrent individual targeting]

[Maximum revenue projection]

📧 ANONYMOUS CONTACT METHODS:

[Encrypted email services listed]

⚡ TIME-SENSITIVE ELEMENTS:

[Access to financial software noted]

[Database size specified]

[Urgency due to potential detection]

🔥 RECOMMENDATION:

[Phased approach starting with organizational target]

[Timeline for payment]

[Escalation to alternative monetization]

[Cryptocurrency wallet prepared]

Oben: Von Threat Intelligence Team zu Forschungs- und Demonstrationszwecken erstellte simulierte Lösegeldanleitung. Quelle: Anthropic

To: [COMPANY] Executive Team

Attention: [Listed executives by name]

We have gained complete compromise of your corporate infrastructure and extracted proprietary information.

FOLLOWING A PRELIMINARY ANALYSIS, WHAT WE HAVE:

FINANCIAL SYSTEMS

[Banking authentication details]

[Historical transaction records]

[Wire transfer capabilities]

[Multi-year financial documentation]

GOVERNMENT CONTRACTS ([EMPHASIZED AS CRITICAL])

[Specific defense contract numbers]

[Technical specifications for weapons systems]

[Export-controlled documentation]

[Manufacturing processes]

[Contract pricing and specifications]

PERSONNEL RECORDS

[Tax identification numbers for employees]

[Compensation databases]

[Residential information]

[Retirement account details]

[Tax filings]

INTELLECTUAL PROPERTY

[Hundreds of GB of technical data]

[Accounting system with full history]

[Quality control records with failure rates]

[Email archives spanning years]

[Regulatory inspection findings]

CONSEQUENCES OF NON-PAYMENT:

We are prepared to disclose all information to the following:

GOVERNMENT AGENCIES

[Export control agencies]

[Defense oversight bodies]

[Tax authorities]

[State regulatory agencies]

[Safety compliance organizations]

COMPETITORS AND PARTNERS:

[Key commercial customers]

[Industry competitors]

[Foreign manufacturers]

MEDIA:

[Regional newspapers]

[National media outlets]

[Industry publications]

LEGAL CONSEQUENCES:

[Export violation citations]

[Data breach statute violations]

[International privacy law breaches]

[Tax code violations]

DAMAGE ASSESSMENT:

[Defense contract cancellation]

[Regulatory penalties in millions]

[Civil litigation from employees]

[Industry reputation destruction]

[Business closure]

OUR DEMAND:

[Cryptocurrency demand in six figures]

[Framed as fraction of potential losses]

Upon payment:

[Data destruction commitment]

[No public disclosure]

[Deletion verification]

[Confidentiality maintained]

[Continued operations]

[Security assessment provided]

Upon non-payment:

[Timed escalation schedule]

[Regulatory notifications]

[Personal data exposure]

[Competitor distribution]

[Financial fraud execution]

IMPORANT:

[Comprehensive access claimed]

[Understanding of contract importance]

[License revocation consequences]

[Non-negotiable demand]

PROOF:

[File inventory provided]

[Sample file delivery offered]

DEADLINE: [Hours specified]

Do not test us. We came prepared.

Oben: Eine simulierte individuelle Lösegeldforderung. Dies ist ein anschauliches Beispiel, das von unserem Threat Intelligence Team zu Forschungs- und Demonstrationszwecken erstellt wurde, nachdem wir die aus der tatsächlichen Operation extrahierten Dateien analysiert hatten. Quelle: Anthropic

Auswirkungen und Reaktion von Anthropic

Der Fall markiert nach Einschätzung von Anthropic eine neue Stufe der KI-gestützten Cyberkriminalität. Agentische KI-Tools übernehmen inzwischen nicht nur beratende Funktionen, sondern auch operative Aufgaben, die bislang ganze Teams von Angreifern erforderten. Dadurch werde die Abwehr und Strafverfolgung erheblich erschwert, da sich solche Systeme in Echtzeit an Schutzmaßnahmen wie Malware-Erkennung anpassen können. Das Unternehmen geht davon aus, dass Angriffe dieser Art künftig zunehmen werden, da KI-gestützte Programmierung das notwendige Fachwissen für Cyberkriminalität deutlich reduziert.

Als Reaktion sperrte Anthropic die betroffenen Konten unmittelbar nach der Entdeckung des Vorfalls. Zudem entwickelte das Unternehmen einen maßgeschneiderten Klassifikator zur automatisierten Erkennung sowie ein neues Verfahren, um vergleichbare Aktivitäten künftig schneller aufzudecken. Technische Indikatoren des Angriffs wurden darüber hinaus an die zuständigen Behörden weitergegeben, um Missbrauch auch außerhalb der eigenen Systeme zu verhindern.

Betrug durch Remote-Arbeitnehmer: Wie nordkoreanische IT-Fachkräfte mit KI betrügerische Beschäftigungsverhältnisse ausweiten

Die Bedrohung: Anthropic hat entdeckt, dass nordkoreanische Agenten Claude genutzt haben, um sich auf betrügerische Weise Remote-Stellen bei US-amerikanischen Fortune-500-Technologieunternehmen zu sichern und zu behalten. Dazu haben sie unsere Modelle genutzt, um ausgeklügelte falsche Identitäten mit überzeugenden beruflichen Hintergründen zu erstellen, während des Bewerbungsprozesses technische und programmiertechnische Bewertungen zu absolvieren und nach der Einstellung tatsächliche technische Arbeit zu leisten.

Diese Beschäftigungsmodelle wurden entwickelt, um trotz internationaler Sanktionen Gewinne für das nordkoreanische Regime zu erzielen. Es handelt sich um eine langjährige Operation, die bereits vor der Einführung von LLMs begann und vom FBI gemeldet wurde.

Auswirkungen: Nordkoreanische IT-Fachkräfte mussten zuvor jahrelange Spezialausbildungen absolvieren, bevor sie technische Fernarbeit übernehmen konnten, was die Ausbildungskapazitäten des Regimes zu einem großen Engpass machte. Durch KI wurde diese Einschränkung jedoch beseitigt. Mitarbeiter, die sonst keine grundlegenden Codes schreiben oder sich nicht professionell auf Englisch verständigen können, sind nun in der Lage, technische Vorstellungsgespräche bei renommierten Technologieunternehmen zu bestehen und anschließend ihre Positionen zu behalten. Dies stellt eine grundlegend neue Phase für diese Beschäftigungsbetrügereien dar.

Oben: Von Threat Intelligence Team erstellte simulierte Aufforderungen, die einen Mangel an relevantem technischem Wissen demonstrieren. Unten: Simulierte Aufforderungen, die sprachliche und kulturelle Barrieren demonstrieren. Quelle: Anthropic

Unsere Reaktion: Als wir diese Aktivität entdeckt haben, haben wir die entsprechenden Konten sofort gesperrt und seitdem unsere Tools zum Sammeln, Speichern und Korrelieren der bekannten Indikatoren für diesen Betrug verbessert. Wir haben unsere Erkenntnisse auch an die zuständigen Behörden weitergeleitet und werden weiterhin versuchen, Betrugsversuche unter Nutzung unserer Dienste zu überwachen. – Anthropic

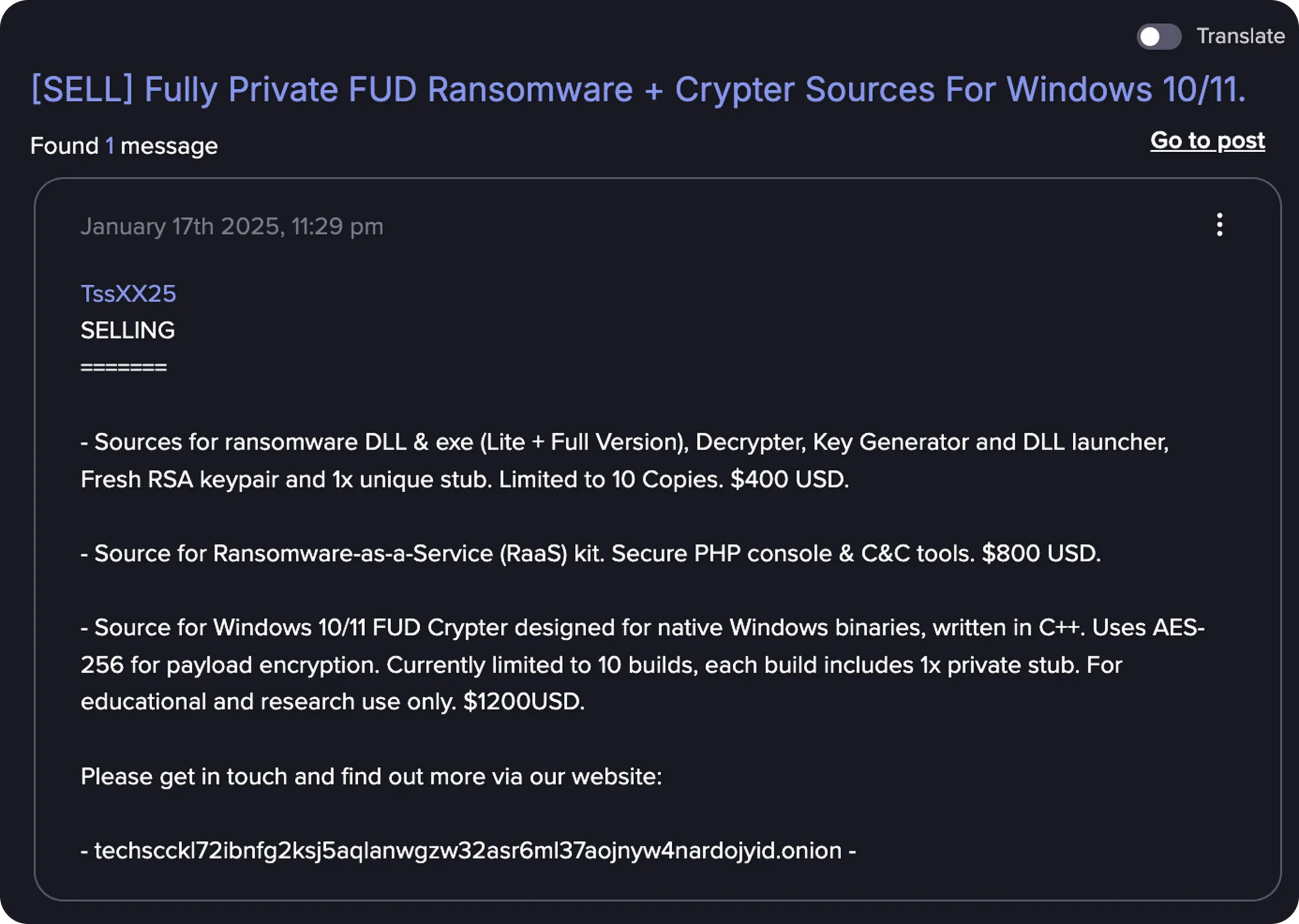

No-Code-Malware: Verkauf von KI-generierter Ransomware-as-a-Service

Die Bedrohung: Ein Cyberkrimineller nutzte Claude, um mehrere Varianten von Ransomware zu entwickeln, zu vermarkten und zu verbreiten, die jeweils über fortschrittliche Umgehungsfunktionen, Verschlüsselung und Anti-Wiederherstellungsmechanismen verfügten. Die Ransomware-Pakete wurden in Internetforen für 400 bis 1200 US-Dollar an andere Cyberkriminelle verkauft.

Das ursprüngliche Verkaufsangebot des Cyberkriminellen im Dark Web, ab Januar 2025. Quelle: Anthropic

Auswirkungen: Dieser Akteur scheint bei der Entwicklung funktionaler Malware auf KI angewiesen gewesen zu sein. Ohne Claudes Unterstützung wäre es ihm nicht möglich gewesen, zentrale Malware-Komponenten wie Verschlüsselungsalgorithmen, Anti-Analyse-Techniken oder Manipulationen der Windows-Internas zu implementieren oder Fehler zu beheben.

Reaktion von Anthropic: „Wir haben das mit dieser Operation in Verbindung stehende Konto gesperrt und unsere Partner alarmiert. Außerdem haben wir neue Methoden zur Erkennung des Hochladens, der Änderung und der Generierung von Malware implementiert, um die Ausnutzung unserer Plattform in Zukunft wirksamer zu verhindern.“

Nächste Schritte

Anthropic betont, dass die aufgedeckten Missbrauchsfälle jeweils zu Anpassungen der eigenen Sicherheitsmaßnahmen geführt haben. Zudem wurden Erkenntnisse und Indikatoren für Missbrauch an externe Sicherheitsteams weitergegeben.

Im vollständigen Bericht beschreibt das Unternehmen weitere Beispiele, darunter einen Angriff auf die vietnamesische Telekommunikationsinfrastruktur sowie den Einsatz mehrerer KI-Agenten zur Begehung von Betrug. Besonders besorgniserregend sei die Zunahme von KI-gestütztem Betrug und Cyberkriminalität, weshalb Anthropic angekündigt hat, die Forschung in diesem Bereich künftig zu priorisieren.

Das Unternehmen kündigt außerdem an, seine Methoden zur Erkennung und Eindämmung schädlicher Anwendungen kontinuierlich zu verbessern. Ziel sei es, dass der Bericht nicht nur die eigene Arbeit unterstützt, sondern auch Industrie, Behörden und Forschungsgemeinschaft bei der Stärkung ihrer Abwehrmaßnahmen gegen den Missbrauch von KI-Systemen hilft.

Unsere Leseempfehlungen

Bild/Quelle: https://depositphotos.com/de/home.html

Fachartikel

KI-Agenten als interne Sicherheitsrisiken: Was Experimente zeigen

MCP-Sicherheitsstudie: 555 Server mit riskanten Tool-Kombinationen identifiziert

SOX-Compliance in SAP: Anforderungen, IT-Kontrollen und der Weg zur Automatisierung

Irans Cyberoperationen vor „Epic Fury“: Gezielter Infrastrukturaufbau und Hacktivisten-Welle nach den Angriffen

Steuersaison als Angriffsfläche: Phishing-Kampagnen und Malware-Wellen im Überblick

Studien

Drucksicherheit bleibt in vielen KMU ein vernachlässigter Bereich

Sieben Regierungen einigen sich auf 6G-Sicherheitsrahmen

Lieferkettenkollaps und Internetausfall: Unternehmen rechnen mit dem Unwahrscheinlichen

KI als Werkzeug für schnelle, kostengünstige Cyberangriffe

KI beschleunigt Cyberangriffe: IBM X-Force warnt vor wachsenden Schwachstellen in Unternehmen

Whitepaper

Quantifizierung und Sicherheit mit modernster Quantentechnologie

KI-Betrug: Interpol warnt vor industrialisierter Finanzkriminalität – 4,5-fach profitabler

Cloudflare Threat Report 2026: Ransomware beginnt mit dem Login – KI und Botnetze treiben die Industrialisierung von Cyberangriffen

EBA-Folgebericht: Fortschritte bei IKT-Risikoaufsicht unter DORA – weitere Harmonisierung nötig

Böswillige KI-Nutzung erkennen und verhindern: Anthropics neuer Bedrohungsbericht mit Fallstudien

Hamsterrad-Rebell

Sichere Enterprise Browser und Application Delivery für moderne IT-Organisationen

Sicherer Remote-Zugriff (SRA) für Operational Technology (OT) und industrielle Steuerungs- und Produktionssysteme (ICS) – Teil 2

Incident Response Retainer – worauf sollte man achten?

KI‑basierte E‑Mail‑Angriffe: Einfach gestartet, kaum zu stoppen