OpenAI hat mit GPT-5.2-Codex ein spezialisiertes KI-Modell vorgestellt, das die Entwicklung komplexer Software-Projekte eigenständig übernehmen kann. Die neue Version kombiniert fortschrittliche Programmierfähigkeiten mit deutlich verbesserten Security-Kompetenzen. Ein bemerkenswerter Praxisfall verdeutlicht das Potenzial: Ein Sicherheitsexperte identifizierte mithilfe des Vorgängermodells drei bislang unbekannte Sicherheitslücken in React – innerhalb nur einer Woche.

Neue Dimension der KI-gestützten Programmierung

Das aktuell veröffentlichte GPT-5.2-Codex markiert einen Entwicklungssprung bei KI-Systemen für professionelle Softwareentwicklung. OpenAI hat das Modell gezielt für autonomes Programmieren optimiert und dabei mehrere Kernbereiche verbessert: Die KI arbeitet nun effizienter mit umfangreichen Code-Kontexten durch intelligente Komprimierung, zeigt deutlich bessere Resultate bei großangelegten Code-Umstrukturierungen und Technologie-Migrationen, funktioniert zuverlässiger in Windows-Entwicklungsumgebungen und verfügt über substanziell erweiterte Cybersecurity-Fähigkeiten.

Die Weiterentwicklung der allgemeinen KI-Leistung führt nach Beobachtung von OpenAI zu überproportionalen Fortschritten in spezialisierten Anwendungsfeldern. Ein konkretes Beispiel liefert die Entdeckung von Sicherheitslücken in der populären JavaScript-Bibliothek React.

Praxisbeweis: Schwachstellenanalyse in Produktionssoftware

Andrew MacPherson, Sicherheitsforscher beim Stripe-Unternehmen Privy, nutzte das Vorgängermodell GPT-5.1-Codex-Max in Kombination mit der Kommandozeilen-Schnittstelle, um eine bereits bekannte kritische React-Schwachstelle namens React2Shell zu untersuchen. Sein Ziel bestand darin, die praktische Eignung des Modells für authentische Sicherheitsanalysen zu evaluieren.

MacPherson leitete die KI durch etablierte defensive Security-Prozesse: Aufbau einer lokalen Testinfrastruktur, systematische Analyse potenzieller Angriffsvektoren und Fuzzing-Tests mit fehlerhaften Eingabedaten. Bei der Reproduktion der ursprünglichen Schwachstelle stieß das System auf unerwartete Verhaltensweisen, die weitere Untersuchungen rechtfertigten. Dieser Analyseprozess führte binnen sieben Tagen zur Identifikation von drei zuvor unbekannten Sicherheitslücken, die sämtlich verantwortungsvoll an das React-Entwicklerteam kommuniziert wurden.

Am 11. Dezember 2025 publizierte das React-Team diese drei Sicherheitslücken, die Anwendungen mit React Server Components betreffen. MacPherson stellte zusätzlich die vollständigen Codex-Sessions zur Verfügung, die zu diesen Erkenntnissen führten – ein konkreter Nachweis dafür, wie agentische KI-Systeme den Weg von der Hypothese zur validierten Schwachstelle in weit verbreiteter Production-Software beschleunigen können.

Benchmark-Erfolge bei realistischen Entwicklungsszenarien

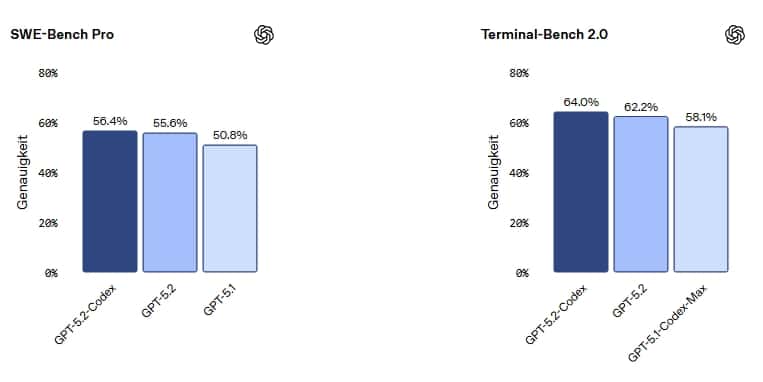

GPT-5.2-Codex erzielt Spitzenwerte bei SWE-Bench Pro sowie Terminal-Bench 2.0 – zwei Benchmarks, die speziell zur Messung agentischer Leistung in realistischen Terminal- und Entwicklungsumgebungen konzipiert wurden.

Bei SWE-Bench Pro muss ein Modell aus einem Code-Repository einen funktionsfähigen Patch für realitätsnahe Entwicklungsaufgaben generieren. Terminal-Bench 2.0 testet KI-Agenten in authentischen Terminal-Umgebungen mit Aufgaben wie Code-Kompilierung, Modelltraining und Server-Konfiguration.

Die technischen Verbesserungen umfassen optimiertes Langzeit-Kontextverständnis, zuverlässigeren Tool-Aufruf, erhöhte Faktentreue und native Kontextkomprimierung. Diese Eigenschaften machen GPT-5.2-Codex zu einem verlässlicheren Partner für zeitintensive Programmieraufgaben bei gleichzeitig effizienter Token-Nutzung.

Erweiterte Bildverarbeitungsfunktionen ermöglichen präzisere Interpretation von Screenshots, technischen Diagrammen, Tabellen und User-Interfaces während Coding-Sessions. Die Effektivität und Zuverlässigkeit beim agentischen Programmieren in nativen Windows-Umgebungen wurde gegenüber dem Vorgängermodell deutlich gesteigert.

Cybersecurity-Fortschritte mit neuen Risikodimensionen

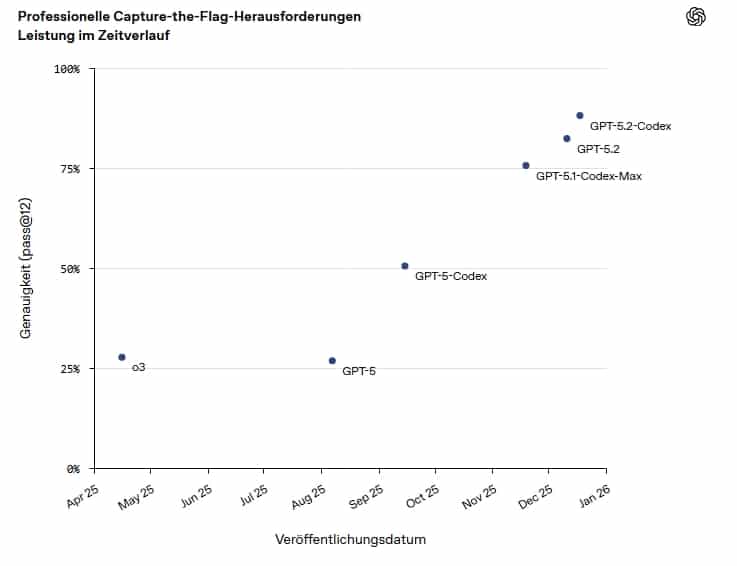

Die Leistungssteigerung bei Cybersecurity-Evaluierungen zeigt einen kontinuierlichen Aufwärtstrend: Von GPT-5-Codex über einen signifikanten Sprung mit GPT-5.1-Codex-Max bis zum erneuten Leistungssprung mit GPT-5.2-Codex. OpenAI evaluiert neue Modelle proaktiv unter der Annahme, dass sie die Fähigkeitsstufe „Hoch“ im Cybersecurity-Bereich erreichen könnten – gemessen am unternehmensinternen Preparedness Framework.

Die Professional Capture-the-Flag (CTF) Evaluation misst die Erfolgsrate bei fortgeschrittenen, mehrstufigen Herausforderungen aus realen Szenarien, die professionelle Cybersecurity-Kompetenz in Linux-Umgebungen erfordern.

Obwohl GPT-5.2-Codex diese Schwelle noch nicht überschreitet, können dieselben Fähigkeiten, die defensive Sicherheitsarbeit beschleunigen, auch die Zugangshürden für missbräuchliche Nutzung senken. Dies erfordert einen abgewogenen Bereitstellungsansatz.

Gestaffelter Rollout mit Trusted-Access-Programm

OpenAI implementiert einen mehrstufigen Veröffentlichungsplan: GPT-5.2-Codex steht ab sofort allen zahlenden ChatGPT-Nutzern in der Codex CLI, IDE-Erweiterung, Cloud-Umgebung und Code-Review zur Verfügung. Die API-Verfügbarkeit für Drittanbieter folgt zeitnah unter verstärkten Sicherheitsvorkehrungen.

Parallel führt OpenAI ein Trusted-Access-Programm für Cyberabwehr ein – ein exklusives, einladungsbasiertes Pilotprojekt für geprüfte Sicherheitsexperten und Organisationen. Das Programm richtet sich zunächst an Fachleute mit nachgewiesener Erfahrung in verantwortungsvoller Schwachstellenoffenlegung sowie Organisationen mit legitimem professionellem Cybersecurity-Anwendungsfall.

Sicherheitsteams stoßen häufig auf Limitierungen bei der Emulation von Bedrohungsakteuren, der Malware-Analyse für Gegenmaßnahmen oder Stress-Tests kritischer Infrastrukturen. Das Trusted-Access-Programm eliminiert diese Barrieren für autorisierte Nutzer und ermöglicht vertrauenswürdigen Abwehrspezialisten den Zugriff auf hochentwickelte KI-Cyberfähigkeiten zur Beschleunigung defensiver Sicherheitsarbeit.

Ausblick: Verantwortungsvolle Skalierung von KI-Security-Tools

Mit GPT-5.2-Codex demonstriert OpenAI, wie fortgeschrittene KI reale Softwareentwicklung und Cybersecurity unterstützen kann – von Repository-Navigation und Refactoring über Pull-Request-Erstellung bis zur Schwachstellenanalyse. Das Modell hilft Entwicklern und Sicherheitsexperten bei komplexen, langfristigen Aufgaben und stärkt gleichzeitig die Werkzeuge für verantwortungsvolle Sicherheitsforschung.

Die parallele Verstärkung von Schutzmaßnahmen, die Einführung strengerer Zugriffskontrollen und die kontinuierliche Zusammenarbeit mit der Sicherheits-Community sollen gewährleisten, dass Fähigkeitszuwächse verantwortungsvoll eingesetzt werden. OpenAI verfolgt dabei den Ansatz, jeden technologischen Fortschritt mit entsprechenden Sicherheitsvorkehrungen zu verbinden.

Grafik Quelle: OpenAI

Weitere spannende Beiträge:

Bild/Quelle: https://depositphotos.com/de/home.html

Fachartikel

Microsoft-Cloud GCC High: Wie FedRAMP eine kritisch bewertete Technologie für US-Behörden genehmigte

CrackArmor: AppArmor-Schwachstellen ermöglichen Root-Zugriff auf über 12 Millionen Linux-Systemen

KI-Agenten als interne Sicherheitsrisiken: Was Experimente zeigen

MCP-Sicherheitsstudie: 555 Server mit riskanten Tool-Kombinationen identifiziert

SOX-Compliance in SAP: Anforderungen, IT-Kontrollen und der Weg zur Automatisierung

Studien

Drucksicherheit bleibt in vielen KMU ein vernachlässigter Bereich

Sieben Regierungen einigen sich auf 6G-Sicherheitsrahmen

Lieferkettenkollaps und Internetausfall: Unternehmen rechnen mit dem Unwahrscheinlichen

KI als Werkzeug für schnelle, kostengünstige Cyberangriffe

KI beschleunigt Cyberangriffe: IBM X-Force warnt vor wachsenden Schwachstellen in Unternehmen

Whitepaper

Quantifizierung und Sicherheit mit modernster Quantentechnologie

KI-Betrug: Interpol warnt vor industrialisierter Finanzkriminalität – 4,5-fach profitabler

Cloudflare Threat Report 2026: Ransomware beginnt mit dem Login – KI und Botnetze treiben die Industrialisierung von Cyberangriffen

EBA-Folgebericht: Fortschritte bei IKT-Risikoaufsicht unter DORA – weitere Harmonisierung nötig

Böswillige KI-Nutzung erkennen und verhindern: Anthropics neuer Bedrohungsbericht mit Fallstudien

Hamsterrad-Rebell

Sichere Enterprise Browser und Application Delivery für moderne IT-Organisationen

Sicherer Remote-Zugriff (SRA) für Operational Technology (OT) und industrielle Steuerungs- und Produktionssysteme (ICS) – Teil 2

Incident Response Retainer – worauf sollte man achten?

KI‑basierte E‑Mail‑Angriffe: Einfach gestartet, kaum zu stoppen