Vertrauenswürdiges Agenten-Computing für Multi-Tenant-Szenarien

Sprachmodellbasierte KI-Agenten werden verstärkt als Cloud-Services bereitgestellt und müssen dabei auf vertrauliche Informationen zugreifen, eigenständig externe Werkzeuge nutzen und mit weiteren Agenten kommunizieren. Die Herausforderung: In diesem komplexen Mehrparteien-Ökosystem können nicht vertrauenswürdige Komponenten zu Sicherheitslücken, Datenabflüssen oder manipuliertem Verhalten führen. Herkömmliche Confidential Virtual Machines (CVMs) bieten lediglich binären Schutz ohne differenzierte Garantien für parteienübergreifendes Vertrauen oder Isolierung auf Beschleunigerebene.

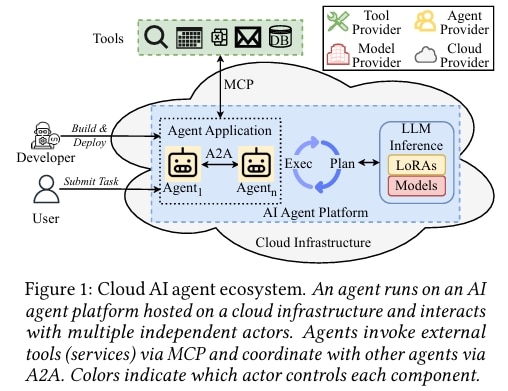

Abbildung 1: Cloud AI agentecosystem. Ein Agent läuft auf einer KI-Agentenplattform, die auf einer Cloud-Infrastruktur gehostet wird, und interagiert mit mehreren unabhängigen Akteuren. Agenten rufen externe Tools (Dienste) über MCP auf und koordinieren sich mit anderen Agenten über A2A. Die Farben zeigen an, welcher Akteur die einzelnen Komponenten steuert.

Verschachtelte Isolierung mit Hardware-Sicherheitsfunktionen

Forscher haben mit Omega ein System entwickelt, das vertrauenswürdige KI-Agenten durch End-to-End-Isolierung ermöglicht. Die Plattform etabliert überprüfbares Vertrauen zwischen allen beteiligten Akteuren und protokolliert jede externe Interaktion mit nachvollziehbarer Herkunft. Omega nutzt CVMs und Confidential GPUs als Basis für eine vertrauenswürdige Agenten-Infrastruktur, die mehrere Agenten innerhalb einer einzelnen CVM durch verschachtelte Isolierungsmechanismen ausführt.

Differentielle Attestierung für komplexe Vertrauensbeziehungen

Das System implementiert eine effiziente Multi-Agenten-Orchestrierung, bei der Vertrauensbeziehungen zwischen unterschiedlichen Prinzipalen über differentielle Attestierung etabliert werden. Ein dediziertes Policy-Framework reguliert Datenzugriffe, Werkzeugnutzung und Agenten-zu-Agenten-Kommunikation zum Schutz sensibler Informationen und zur Einhaltung regulatorischer Anforderungen.

Die Implementierung erfolgt auf AMD SEV-SNP und NVIDIA H100, wobei der Agentenstatus vollständig über die CVM-GPU-Verbindung abgesichert wird. Das Cloud-Ökosystem umfasst Agenten, die auf der gehosteten Plattform laufen und über das Model Context Protocol (MCP) externe Tools aufrufen sowie über Agent-to-Agent-Protokolle (A2A) koordinieren.

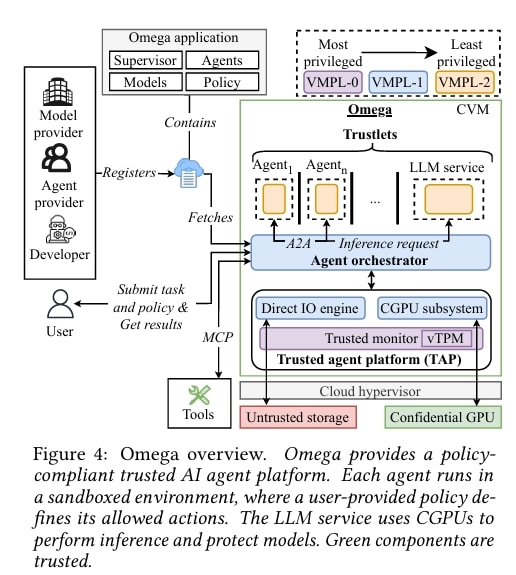

Abbildung 4: Omega-Übersicht. Omega bietet eine richtlinienkonforme, vertrauenswürdige KI-Agentenplattform. Jeder Agent läuft in einer Sandbox-Umgebung, in der eine vom Benutzer bereitgestellte Richtlinie die zulässigen Aktionen definiert. Der LLM-Dienst verwendet CGPUs, um Inferenz durchzuführen und Modelle zu schützen. Grüne Komponenten sind vertrauenswürdig.

Sandbox-Umgebungen mit deklarativer Richtliniensprache

Jeder Agent wird in einer Sandbox-Umgebung ausgeführt, in der benutzerdefinierte Richtlinien die zulässigen Aktionen spezifizieren. Der LLM-Service nutzt Confidential GPUs für Inferenz-Operationen und Modellschutz. Die vertrauenswürdigen Komponenten sind in der Systemarchitektur klar gekennzeichnet.

Omegas verschachtelte vertrauliche Ausführung gewährleistet robuste Isolierung in Multi-Tenant-Umgebungen. Der Attestierungsdienst und Trusted-Boot-Mechanismen unterstützen komplexe Mehrparteien-Vertrauensmodelle. Die neuartige deklarative Richtliniensprache setzt detaillierte Compliance-Vorgaben durch und mitigiert kritische Bedrohungen wie Prompt-Injection-Angriffe effektiv.

Hochleistungsfähige Multi-Agenten-Deployments

Die Plattform erreicht hohe Performance bei gleichzeitiger Unterstützung dichter, richtlinienkonformer Multi-Agenten-Deployments in Cloud-Dimensionen. Das System ebnet den Weg für sichere, compliance-konforme und leistungsstarke KI-Agenten-Deployments in nicht vertrauenswürdigen Cloud-Infrastrukturen.

Die Forscher stellen Omega samt vollständigem Versuchsaufbau als Open-Source-Projekt öffentlich zur Verfügung, um weitere Entwicklungen im Bereich vertrauenswürdiger KI-Agenten zu fördern.

Ursprünglich veröffentlicht von arXiv / Dimitrios Stavrakakis

Auch interessant:

Fachartikel

CrackArmor: AppArmor-Schwachstellen ermöglichen Root-Zugriff auf über 12 Millionen Linux-Systemen

KI-Agenten als interne Sicherheitsrisiken: Was Experimente zeigen

MCP-Sicherheitsstudie: 555 Server mit riskanten Tool-Kombinationen identifiziert

SOX-Compliance in SAP: Anforderungen, IT-Kontrollen und der Weg zur Automatisierung

Irans Cyberoperationen vor „Epic Fury“: Gezielter Infrastrukturaufbau und Hacktivisten-Welle nach den Angriffen

Studien

Drucksicherheit bleibt in vielen KMU ein vernachlässigter Bereich

Sieben Regierungen einigen sich auf 6G-Sicherheitsrahmen

Lieferkettenkollaps und Internetausfall: Unternehmen rechnen mit dem Unwahrscheinlichen

KI als Werkzeug für schnelle, kostengünstige Cyberangriffe

KI beschleunigt Cyberangriffe: IBM X-Force warnt vor wachsenden Schwachstellen in Unternehmen

Whitepaper

Quantifizierung und Sicherheit mit modernster Quantentechnologie

KI-Betrug: Interpol warnt vor industrialisierter Finanzkriminalität – 4,5-fach profitabler

Cloudflare Threat Report 2026: Ransomware beginnt mit dem Login – KI und Botnetze treiben die Industrialisierung von Cyberangriffen

EBA-Folgebericht: Fortschritte bei IKT-Risikoaufsicht unter DORA – weitere Harmonisierung nötig

Böswillige KI-Nutzung erkennen und verhindern: Anthropics neuer Bedrohungsbericht mit Fallstudien

Hamsterrad-Rebell

Sichere Enterprise Browser und Application Delivery für moderne IT-Organisationen

Sicherer Remote-Zugriff (SRA) für Operational Technology (OT) und industrielle Steuerungs- und Produktionssysteme (ICS) – Teil 2

Incident Response Retainer – worauf sollte man achten?

KI‑basierte E‑Mail‑Angriffe: Einfach gestartet, kaum zu stoppen