Systeme der Künstlichen Intelligenz haben enormes Potential und finden Anwendung in immer mehr Lebensbereichen. Doch wie sicher und beherrschbar sind die Systeme, die sich durch Lernen ständig verändern? Eine wirksame Regulierung muss gut dosiert sein.

Sprachassistenten, Übersetzungen auf Knopfdruck, Predictive Maintenance oder Bewerbermanagement-Systeme: Künstliche Intelligenz (KI) ist aus dem Alltag, privat wie beruflich, nicht mehr wegzudenken. Dabei steht die Technologie erst am Anfang ihrer Entwicklung, viele der künftigen Einsatzgebiete sind noch gar nicht abzusehen. Hier eröffnen sich große Chancen für Entwickler und Hersteller, mit Verbesserungen durch künstliche Intelligenz Wettbewerbsvorteile zu erzielen.

Wenn Algorithmen entscheiden

Die neue Technologie bringt neben Erleichterungen aber auch Unsicherheiten mit sich. Was bedeutet es, wenn Algorithmen über den Erfolg der Bewerbung oder die Bewilligung des Kreditantrages entscheiden? Wie verhält sich KI in Gefahrensituationen, etwa beim autonomen Fahren? An welcher Stelle muss ein menschlicher Entscheider eingreifen? Die Diskussionen sind häufig geprägt von der Forderung nach mehr Einblick und Transparenz. Während kaum jemand auf die Idee käme, vom Hersteller eines Autos eine Veröffentlichung der Konstruktionszeichnungen zu verlangen, wird bei Software im Zweifelsfall recht schnell der Ruf nach Offenlegung des Codes laut. Im ersten Fall begründet sich das größere Vertrauen nicht nur im Reifegrad der Technologie, sondern auch in dem Wissen, dass in der Automobilproduktion seit langem gesetzliche Vorgaben, Normen und Standards gelten. Auf Systeme der Künstlichen Intelligenz trifft dies in dem Maße noch nicht zu.

Anforderungen an KI-Systeme sollten klar und angemessen sein

Das verunsichert nicht nur die Anwender, sondern auch die Anbieter von KI-Systemen. Wenn nicht klar ist, welche Anforderungen künftig gelten, könnten neu entwickelte Produkte im Zweifelsfall nicht zugelassen oder müssten aufwändig nachgerüstet werden. So essentiell der Schutz der Anwender vor möglichen Gefahren durch KI-gestützte Produkte ist – zu große Hürden durch Regulierung könnten auf der anderen Seite Hersteller auch davon abhalten, in die Entwicklung der Zukunftstechnologie zu investieren. Der Aufwand etwa für eine Konformitätsbewertung muss vertretbar sein, sonst würden gerade kleinere Unternehmen abgehängt. Auch bei den Anforderungen ist es wichtig, nicht über das Ziel hinaus zu schießen. Wenn das Ziel ist, KI-bedingte, zusätzliche Gefährdungspotentiale zu begrenzen, dann sollten im Ergebnis KI-basierte Systeme oder Produkte genauso sicher sein wie die bisher genutzten Produkte oder Prozesse. Bestehende Prozesse mittels KI besser, zuverlässiger und sogar sicherer zu machen – das kann der Anspruch der Hersteller sein, es darf aber nicht Voraussetzung werden, um KI-basierte Systemen überhaupt im Markt zuzulassen. Ebenso wie Produkte ohne KI werden auch Produkte mit KI nicht völlig fehlerfrei arbeiten und das sollte auch nicht die Erwartung sein, wenn fehlerbehaftete Produkte an anderer Stelle in gewissem Maße toleriert werden.

Darauf verweist auch Bitkom e.V. in einer Stellungnahme zur Haftung für Systeme Künstlicher Intelligenz1, die sich mit den aktuellen Diskussionen, insbesondere mit dem Weißbuch der EU-Kommission zur Künstlichen Intelligenz, auseinandersetzt. Die Bitkom-Bewertungen beziehen sich dabei ausdrücklich auf gegenwärtig bereits genutzte KI-Systeme. Die Autoren der Bitkom sehen das Gefährdungspotential von KI-basierten Systemen durch die bestehenden Haftungsvorschriften bereits abgedeckt und plädieren dafür, den bisher gültigen technologieneutralen Ansatz bei Haftungsbestimmungen beizubehalten. Haftung und mögliche Sanktionen sollten demnach am typischen Gefahrenpotential eines Geräts oder einer Handlung auszurichten sein.

Undurchschaubar und veränderbar: Was KI besonders macht

Dabei wird auch klar herausgestellt, worin die besonderen Herausforderungen der Bewertung von KI-Systemen bestehen. Während Eigenschaften wie Komplexität, Konnektivität und Autonomie auch auf viele andere Systeme und Umgebungen zutreffen, sind KI-Systeme im engeren Sinn durch ihre Veränderbarkeit, Datenabhängigkeit und Opazität charakterisiert. Mittels Machine Learning sind Systeme der Künstlichen Intelligenz in der Lage, auf Basis von Trainingsdaten selbstständig Muster und Zusammenhänge zu erkennen und Schlüsse zu ziehen. KI lernt und verändert sich! Sie kann sich – im Gegensatz zu Produkten ohne KI – auch Verändern, nachdem sie in Verkehr gebracht wurde und das ist im Vergleich zu herkömmlicher Software neu. Die Ergebnisse, also auch mögliche Fehlschlüsse oder Diskriminierungen, hängen dabei in erster Linie von den Daten ab, anhand derer das System lernt. Unter Opazität wird die Undurchschaubarkeit verstanden, mit der KI-Systeme zu ihren Ergebnissen gelangen. Das betrifft in besonderem Maße Methoden des Deep Learning mittels neuronaler Netze. Die zugrundeliegenden Verfahren sind so komplex, dass die Schlüsse nicht unmittelbar nachvollzogen und somit geprüft werden könnten.

Diese Besonderheiten erklären andererseits aber auch, warum Regulierungsbestrebungen, etwa auf EU-Ebene, auch bei der Technologie selbst ansetzen: Vergleichbar zu Produktionsprozessen sollen Regeln aufgestellt werden, wie sichere und vertrauenswürdige KI „produziert“, also entwickelt werden kann. Grundsätzlich sind klare Vorgaben und Prüfverfahren auch im Interesse der Hersteller, da dies das Vertrauen in die Produkte steigert.

Vertrauen durch externe Prüfung und Zertifizierung

In diesem Zusammenhang ist es erforderlich, spezielle IT-Sicherheitszertifizierungsverfahren für KI-basierte Systeme zu entwickeln. Ausgehend von bereits existierenden Zertifizierungsverfahren wird bereits durch die aktuelle KI-Normungsroadmap des DIN und des DKE vorgegeben. Die Normungsroadmap kommt bereits im Vorwort zu dem Schluss, dass „noch ein erheblicher Forschungsbedarf u. a. zur Erstellung der erforderlichen Qualitätsmetriken und Prüfprofile für eine risiko-adaptierte Zertifizierung von KI-Komponenten besteht.“4

Im Zusammenhang mit der IT-Sicherheit strebt die KI-Normungsroadmap die Erstellung einer horizontalen KI-Sicherheitsnorm an. Die Entwicklung von Zertifizierungsverfahren soll im Rahmen eines nationalen Umsetzungsprogramms „Trusted AI“ vorangetrieben werden. In der Roadmap wird festgestellt, dass als erster Schritt eine angemessene Recherche, Prüfung und Bewertung vorhandener Normen, Konformitäts- und Zertifizierungsverfahren sowie Regulierungen für die IT-Sicherheit und Risikobewertung angesehen wird, um diese um KI-Spezifika und ggf. um Dokumentationsanforderungen zu erweitern.

Die Standardisierungsarbeiten im DIN werden ergänzt durch Standardisierungsarbeiten auf internationaler Ebene – vor allem bei ETSI und bei der ENISA:

- ETSI hat 2020 eine umfassende Beschreibung der grundlegenden Probleme bei der Gewährleistung einer angemessenen IT-Sicherheit von KI-basierten Systemen vorgelegt. Mit Fokus auf das Thema „Machine Learning“ werden die Herausforderungen bezüglich Vertraulichkeit, Integrität und Verfügbarkeit für alle Stufen des Machine Learing-Lebenszyklus dargelegt. In diesem Zusammenhang werden auch generelle Herausforderungen von KI-Systemen, wie Bias oder Erklärbarkeit sowie eine Reihe von denkbaren Angriffsvektoren dargestellt. Als erster Schritt ist bei ETSI die Entwicklung einer Bedrohungs-Ontologie geplant, auf deren Grundlage dann Spezifikationen (Ziele, Methoden und Techniken) für das Security Testing von KI-basieren Systemen abgeleitet werden sollen.

- Die ENISA hat im Dezember 2020 selbst eine erste Taxonomie für Bedrohungen von KI-basierten Systemen vorgelegt. Dieses Dokument empfiehlt, die Sicherheitsbewertung von KI-basierten Systemen an einem Lifecycle-Konzept zu orientieren und fasst für alle relevanten Lifecycle Bedrohungen zusammen. Diese können als Grundlage für eine systematische Bedrohungsanalyse von KI-basierten Systemen genutzt werden.

Aktueller Stand – Rechtsrahmen der EU

Der Prozess ist der Regulierung ist bereits fortgeschritten. Seit 2018 hat die EU-Kommission eine europäische Strategie, einen koordinierten Plan und Leitlinien für vertrauenswürdige KI entwickelt. Das bereits erwähnte „Weißbuch zur Künstlichen Intelligenz“ 2 wurde 2020 zur öffentlichen Konsultation gestellt. Im Ergebnis veröffentlichte die Europäische Kommission zuletzt am 21. April 2021 den weltweit ersten Rechtsrahmen für Künstliche Intelligenz.3

Für eine angemessene Regulierung werden KI-Anwendungen nach Risiken klassifiziert: von minimal, gering und hoch bis unannehmbar. Während als unannehmbar eingestufte Risikoszenarien wie etwa Social Scoring verboten sind, sollen Anwendungen mit minimalen Risiken, etwa der Einsatz von KI in Spamfiltern, keiner Regulierung unterliegen. Bei Anwendungen mit minimalen Risiken wie zum Beispiel Chatbots, muss Nutzern lediglich bewusst gemacht werden, dass sie mit einer Maschine interagieren.

Maßgeblich für Hersteller (und Betreiber) sind mithin die KI-Anwendungen mit hohem Risiko, denn diese sollen entsprechenden Anforderungen genügen, bevor sie in Verkehr gebracht werden dürfen. Beispiele für solche KI-Einsatzszenarien sind kritische Infrastrukturen, in denen Leben und Gesundheit von Menschen beeinträchtigt werden könnten; wichtige private und öffentliche Dienstleistungen, Sicherheitskomponenten von Produkten, aber auch Anwendungen in der Schul- und Berufsausbildung und im Personalmanagement, die Zugang zu Bildung oder Berufsleben betreffen. Für diese Hochrisiko-Szenarien gelten besondere Anforderungen an Robustheit, Sicherheit und Genauigkeit der Systeme sowie strenge Vorgaben zur Risikobewertung und -minderung, Nutzerinformation und menschlicher Aufsicht. Darüber hinaus sieht der Rechtsrahmen hier auch grundlegende Anforderungen für Entwicklung und Dokumentation von KI-Systemen vor:

- hohe Qualität der Datensätze, die in das System eingespeist werden und auf dessen Basis die KI lernt, um Risiken und diskriminierende Ergebnisse so gering wie möglich zu halten:

- Protokollierung der Vorgänge, um die Rückverfolgbarkeit von Ergebnissen zu ermöglichen;

- ausführliche Dokumentation zur Beurteilung der Konformität

Ausblick

Neben weiteren Abstimmungen steht nun in Zukunft viel Detailarbeit an; es sind die entsprechenden Normen und Standards auszuarbeiten und Verfahren zur Konformitätsbewertung zu entwickeln.

Dabei sollte auch der organisatorische Aufwand für Hersteller in einem angemessenen Rahmen gehalten werden, um die Entwicklungen von KI-Systemen nicht zu behindern.

Quellen

2 WEISSBUCH Zur Künstlichen Intelligenz – ein europäisches Konzept für Exzellenz und Vertrauen. Brüssel,

19.02.2020. COM(2020) 65 final

3 https://ec.europa.eu/commission/presscorner/detail/de/ip_21_1682

4 DIN, DKE; Deutsche Normungsroadmap Künstliche Intelligenz, November 2020, https://www.dke.de/de/arbeitsfelder/core-safety/normungsroadmap-ki

Autor: Heiko-Randolf Skerka, SRC GmbH

Fachartikel

Studien

Cloud-Transformation & GRC: Die Wolkendecke wird zur Superzelle

Threat Report: Anstieg der Ransomware-Vorfälle durch ERP-Kompromittierung um 400 %

Studie zu PKI und Post-Quanten-Kryptographie verdeutlicht wachsenden Bedarf an digitalem Vertrauen bei DACH-Organisationen

Zunahme von „Evasive Malware“ verstärkt Bedrohungswelle

Neuer Report bestätigt: Die Zukunft KI-gestützter Content Creation ist längst Gegenwart

Whitepaper

Unter4Ohren

Datenklassifizierung: Sicherheit, Konformität und Kontrolle

Die Rolle der KI in der IT-Sicherheit

CrowdStrike Global Threat Report 2024 – Einblicke in die aktuelle Bedrohungslandschaft

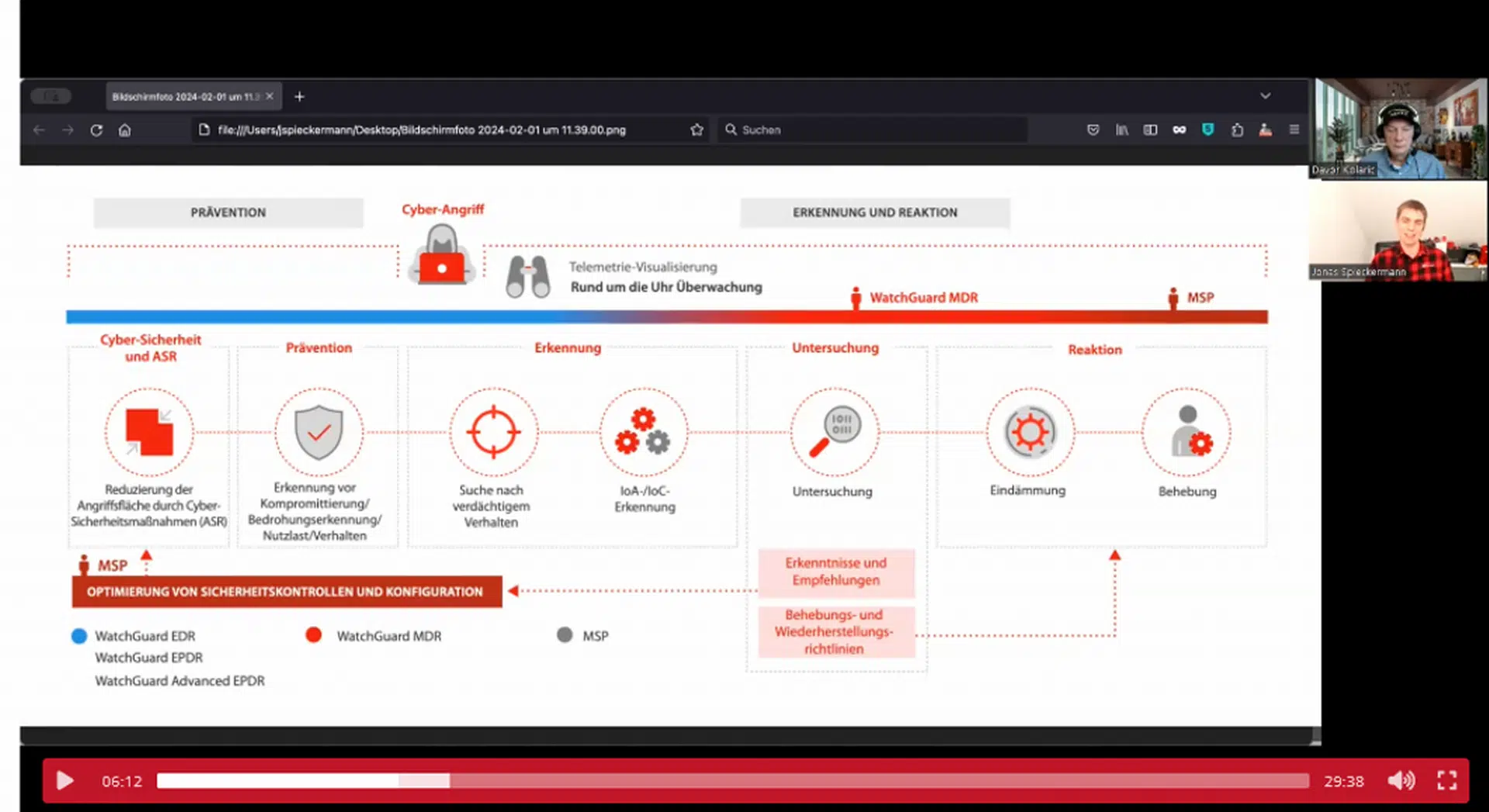

WatchGuard Managed Detection & Response – Erkennung und Reaktion rund um die Uhr ohne Mehraufwand