Die Aussagen des Google-Entwicklers Blake Lemoine haben in den vergangenen Tagen für einiges Aufsehen gesorgt. Demnach hatte der von Google entwickelte Chatbot LaMDA ein Bewusstsein entwickelt und sich sogar einen Anwalt zur Vertretung seiner Interessen genommen. Als Nachweis verweist Lemoine auf ein 21 Seiten umfassendes Gesprächsprotokoll mit LaMDA. Allerdings räumt auch Lemoine ein, dass diese Einschätzung einer Experten-Überprüfung bedürfe. Laut Viacheslav Gromov, CEO und Gründer vom Embedded-KI-Fullstack-Anbieter AITAD ist es eher unwahrscheinlich, dass LaMDA ein Bewusstsein entwickelt:

Viel wahrscheinlicher ist es, dass LaMDA ein Bewusstsein perfekt imitiert. Denn genau darauf wird Künstliche Intelligenz (KI) trainiert. Gromov verweist auf bestehende performante KI-Chatbots wie Mitsuku und die perfekte, scheinbar reale Muster-Imitation mit dem Gelernten aus großen Datenspeichern und dem öffentlichen Internet. So entstehen kohärente, intelligente und emotionale Antworten. Dahinter existiert aber kein tiefergehendes Verständnis der Inhalte. Eine KI mit Bewusstsein liegt zudem oft nicht im Interesse der Entwicklung, da es dafür gar keine konkreten Anwendungsfälle in der Industrie gibt. Es wird kein Bewusstsein gebraucht und gewollt, damit KI effektiv in Medizingeräten oder selbstfahrenden Autos wirkt oder um Sprache, Bewegungen oder Objekte zu erkennen.

Die Frage nach Normierung und gesetzlicher Regelung

Der Turing-Test oder auch Searles Chinesisches Zimmer zeigen, wie schwierig es ist, Maschinen auf Intelligenzmerkmale zu testen. Zum Bewusstsein gehört auch Embodiment – also die Einheit mit Körper, Spüren und Erleben und sich dessen bewusst zu sein. Das sogenannte phänomenale Bewusstsein als Teilaspekt des übergreifenden Bewusstseins ist also bei einem Chatbot in der bekannten Art gar nicht möglich, da ihm der Körper fehlt. Zahlreiche Theorien zur Entstehung von Bewusstsein und komplexen Emotionen nur aufgrund hormon- und körperprozessbedingter Prozesse im Hirn, wie es auch Catrin Misselhorn in ihrem Standardwerk „Grundlagen der Maschinenethik“ (Reclam, 2018) beschreibt, sprechen dagegen. Selbst die Neurologie bei biologisch gezüchteten Neuronen-Netzen ist nicht in der Lage, Bewusstsein in der Petrischale zu erzeugen.

AITAD beteiligt sich in einigen KI-Normierungs- und Lenkungsgremien. Hier wird klar: Im Fall, dass es bewusstseinsähnliche Erscheinungen gäbe, bräuchte die Zulassung solcher Produkte mindestens 5 bis 10 Jahre. Der gesellschaftliche Konsens hierzu müsste groß sein. Die EU zeigt bereits mit dem aktuellen „AI Act“-Vorschlag deutliche Fortschritte in Richtung der Zulassung von aktuellen, industriellen KIs.

KI löst durch ihre Leistungsfähigkeit immer wieder Bewunderung aus und bietet in vielen fest definierten Bereichen einen hohen Mehrwert. Eine Gefahr ist sie jedoch nicht. Auch AITAD entwickelt KI-Systeme. Diese sind Hardware-gebunden (Embedded-KI) und lösen wiederkehrende gleichartige Aufgaben mit hoher Zuverlässigkeit. Damit sorgen die AITAD-Lösungen beispielsweise durch Predictive Maintenance für eine annähernd 100prozentige Maschinenverfügbarkeit, im Operationssaal für die Früherkennung von Komplikationen oder für Sicherheit in gefährlichen Industrieumgebungen.

Quellennachweis:

– https://de.wikipedia.org/wiki/Mitsuku

– https://www.documentcloud.org/documents/22058315-is-lamda-sentient-an-interview

– https://de.wikipedia.org/wiki/Turing-Test

– https://de.wikipedia.org/wiki/Chinesisches_Zimmer

– https://artificialintelligenceact.eu

Fachartikel

Studien

Drei Viertel aller DACH-Unternehmen haben jetzt CISOs – nur wird diese Rolle oft noch missverstanden

AI-Security-Report 2024 verdeutlicht: Deutsche Unternehmen sind mit Cybersecurity-Markt überfordert

Cloud-Transformation & GRC: Die Wolkendecke wird zur Superzelle

Threat Report: Anstieg der Ransomware-Vorfälle durch ERP-Kompromittierung um 400 %

Studie zu PKI und Post-Quanten-Kryptographie verdeutlicht wachsenden Bedarf an digitalem Vertrauen bei DACH-Organisationen

Whitepaper

Unter4Ohren

Datenklassifizierung: Sicherheit, Konformität und Kontrolle

Die Rolle der KI in der IT-Sicherheit

CrowdStrike Global Threat Report 2024 – Einblicke in die aktuelle Bedrohungslandschaft

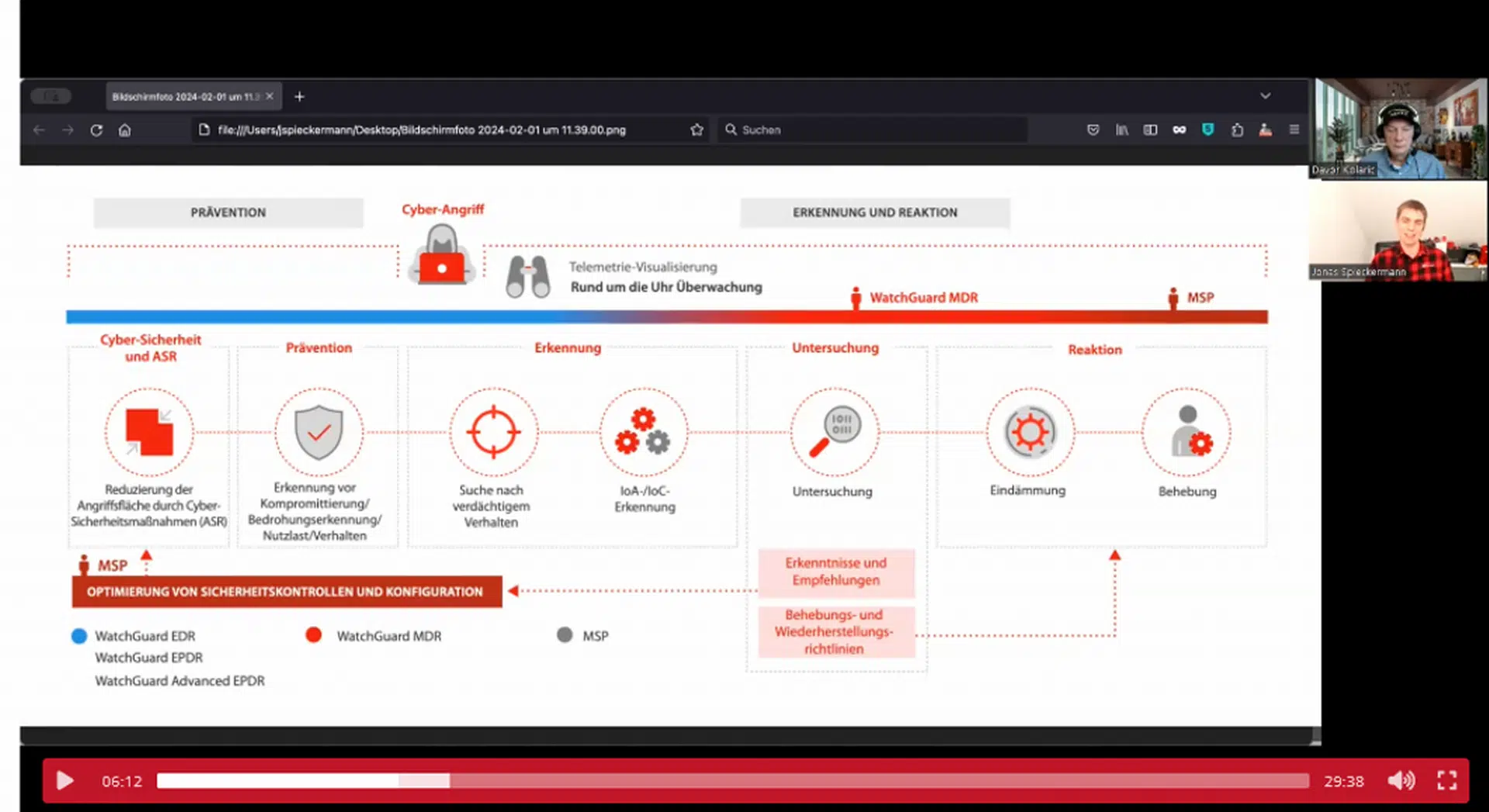

WatchGuard Managed Detection & Response – Erkennung und Reaktion rund um die Uhr ohne Mehraufwand