Die Sicherheit von Systemen basierend auf Künstlicher Intelligenz (KI) ist ein breiter und aktiver Forschungsbereich mit hohen Einstiegshürden. Im Rahmen des Projektes „Sicherheit von KI-Systemen: Grundlagen“ hat das Bundesamt für Sicherheit in der Informationstechnik (BSI) drei Studien zu diesem Themenkomplex in Auftrag gegeben, die sich an KI-Expertinnen und Experten richten:

Security of AI-Systems: Fundamentals – Adversarial Deep Learning

Security of AI-Systems: Fundamentals – Provision or use of external data or trained models

Security of AI-Systems: Fundamentals Security Considerations for Symbolic and Hybrid AI

Die Studien geben einen Einblick in den aktuellen Stand der Forschung. Es werden mögliche Angriffe auf KI-Systeme und Verteidigungsmaßnahmen kategorisiert und bewertet sowie auf Basis der Literatur Handlungsempfehlungen abgeleitet. Gleichzeitig wird auf offene Probleme und die Limitationen existierender Mitigationsmaßnahmen hingewiesen. Zum Teil geben die Studien auch Impulse für zukünftige Sicherheitsforschung im Bereich der KI.

Die Ergebnisse der Studien dienen dem BSI unter anderem als Grundlage für Beratungsdienstleistungen und die Entwicklung von Prüfkriterien für KI-Systeme. Sie stellen aber auch für andere Gruppen, wie Entwicklerinnen und Entwickler, eine vertrauenswürdige Informationsquelle dar. Durch die strukturierte Aufbereitung werden Einstiegshürden in das Thema verringert.

Fachartikel

Studien

Cloud-Transformation & GRC: Die Wolkendecke wird zur Superzelle

Threat Report: Anstieg der Ransomware-Vorfälle durch ERP-Kompromittierung um 400 %

Studie zu PKI und Post-Quanten-Kryptographie verdeutlicht wachsenden Bedarf an digitalem Vertrauen bei DACH-Organisationen

Zunahme von „Evasive Malware“ verstärkt Bedrohungswelle

Neuer Report bestätigt: Die Zukunft KI-gestützter Content Creation ist längst Gegenwart

Whitepaper

Unter4Ohren

Datenklassifizierung: Sicherheit, Konformität und Kontrolle

Die Rolle der KI in der IT-Sicherheit

CrowdStrike Global Threat Report 2024 – Einblicke in die aktuelle Bedrohungslandschaft

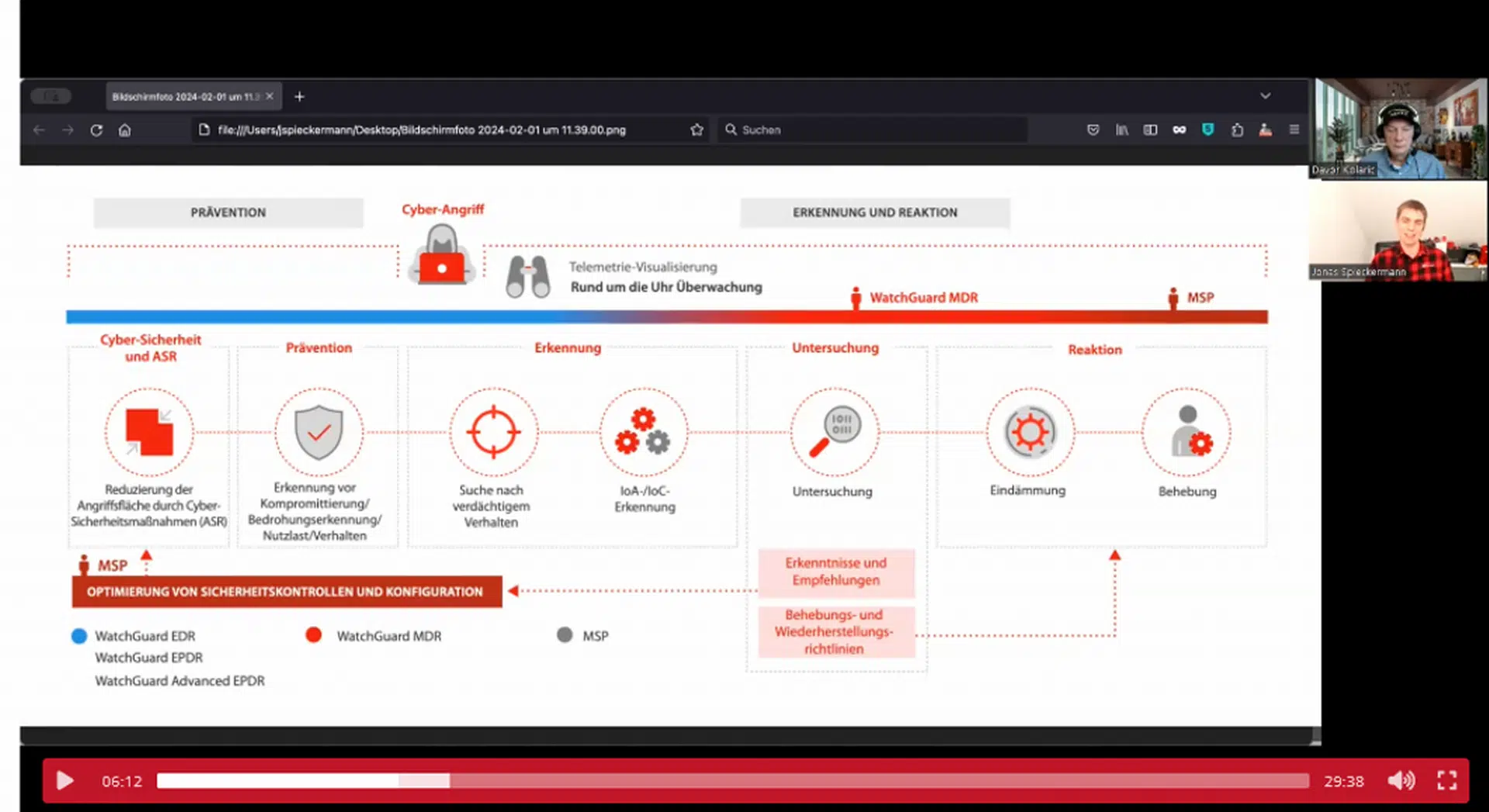

WatchGuard Managed Detection & Response – Erkennung und Reaktion rund um die Uhr ohne Mehraufwand