Forschungsprojekt entwickelt Lösung zur automatisierten Erkennung von illegalen Finanzflüssen – inklusive prüfbarer Mindestanforderungen für den Einsatz von künstlicher Intelligenz in sensiblen Bereichen

Im Kampf gegen Geldwäsche arbeiten etablierte softwarebasierte Erkennungsverfahren zu unpräzise und schlagen oft falschen Alarm. Ermittlungsbehörden sind dadurch oft überlastet, denn sie müssen jedem Verdacht nachgehen. Im neuen Forschungsprojekt MaLeFiz (Maschinelles Lernen zur Identifikation auffälliger Finanztransaktionen) arbeiten Forschende jetzt an einer Lösung, die mit maschinellem Lernen – eine Technik der künstlichen Intelligenz – die Suche nach illegalen Geldflüssen verbessern und präziser gestalten soll, sodass weniger Fehlalarme generiert werden. Zusätzlich entwickeln die Projektpartner Mindestanforderungen und Kontrollmechanismen für KI-Lösungen, die in der Finanzwirtschaft eingesetzt werden. Darüber hinaus sollen die Ergebnisse der KI nachvollziehbar gemacht werden. Beteiligt sind die Deloitte GmbH, das Fraunhofer-Institut für Sichere Informationstechnologie SIT, die Martin-Luther-Universität Halle-Wittenberg, die Universität Leipzig und das Zentrum Technik und Gesellschaft der TU Berlin. Das Projekt MaLeFiz wird vom Bundesministerium für Bildung und Forschung finanziert und läuft drei Jahre. Das Fraunhofer SIT leitet das Projekt und ist für die Entwicklung des KI-basierten Werkzeugs verantwortlich. Weitere Informationen unter www.sit.fraunhofer.de/malefiz.

Ein wichtiger Baustein im Kampf gegen Geldwäsche ist die Analyse von Finanztransaktionen. Die gängigen Analyseverfahren identifizieren aber zu viele Verdachtsfälle, die alle individuell von speziell geschulten Analyst*innen nachgeprüft werden müssen. Die zuständige Behörde, die Financial Intelligence Unit oder kurz FIU, erhielt allein in den vergangenen beiden Jahren pro Jahr rund 300.000 Meldungen und hat aktuell noch rund 290.000 nicht abschließend bearbeitete Eingänge. Die Methoden der künstlichen Intelligenz versprechen bessere Analysemöglichkeiten , sprich: weniger Fehlalarme (False Positives). Für die Entwicklung der technischen Lösung nutzt das Forschungsteam Methoden des maschinellen Lernens.

Transparente Entscheidungen der künstlichen Intelligenz

Damit die Ergebnisse solcher Analysen auch vor Gericht Bestand haben, müssen die IT-Lösungen gewisse Voraussetzungen erfüllen. So müssen die Entscheidungen einer KI zum Beispiel nachvollziehbar sein: Die KI soll keine „Blackbox“ sein und einfach eine Liste an Verdachtsfällen ausspucken, sondern transparent machen, auf welcher Grundlage sie einen Verdachtsfall markiert. Entsprechend erforscht das Team rechtliche und ethische Fragestellungen . Ein Ziel des Projektes ist es, einen Katalog mit Mindestanforderungen für KI-Lösungen in der Finanzwirtschaft zu erarbeiten, die sich zum Beispiel im Rahmen einer Auditierung nachprüfen lassen – eine Art TÜV für Anwendungen mit künstlicher Intelligenz. Um zu erfahren, wie die KI praktisch beschaffen sein sollte und um Bedürfnisse der Anwender*innen so weit wie möglich zu berücksichtigen, führen die Projektpartner Interviews, Workshops und Tests mit Benutzer*innen durch. All diese Ergebnisse fließen dann in einen Demonstrator ein, der auch in Banken unter realen Bedingungen getestet werden wird. Der Demonstrator, der Katalog mit Mindestanforderungen sowie weitere Projektergebnisse werden nach Projektabschluss im September 2025 der Öffentlichkeit zugänglich gemacht.

Folgen Sie uns auf Twitter: https://twitter.com/fraunhofersit

Fachartikel

Studien

Drei Viertel aller DACH-Unternehmen haben jetzt CISOs – nur wird diese Rolle oft noch missverstanden

AI-Security-Report 2024 verdeutlicht: Deutsche Unternehmen sind mit Cybersecurity-Markt überfordert

Cloud-Transformation & GRC: Die Wolkendecke wird zur Superzelle

Threat Report: Anstieg der Ransomware-Vorfälle durch ERP-Kompromittierung um 400 %

Studie zu PKI und Post-Quanten-Kryptographie verdeutlicht wachsenden Bedarf an digitalem Vertrauen bei DACH-Organisationen

Whitepaper

Unter4Ohren

Datenklassifizierung: Sicherheit, Konformität und Kontrolle

Die Rolle der KI in der IT-Sicherheit

CrowdStrike Global Threat Report 2024 – Einblicke in die aktuelle Bedrohungslandschaft

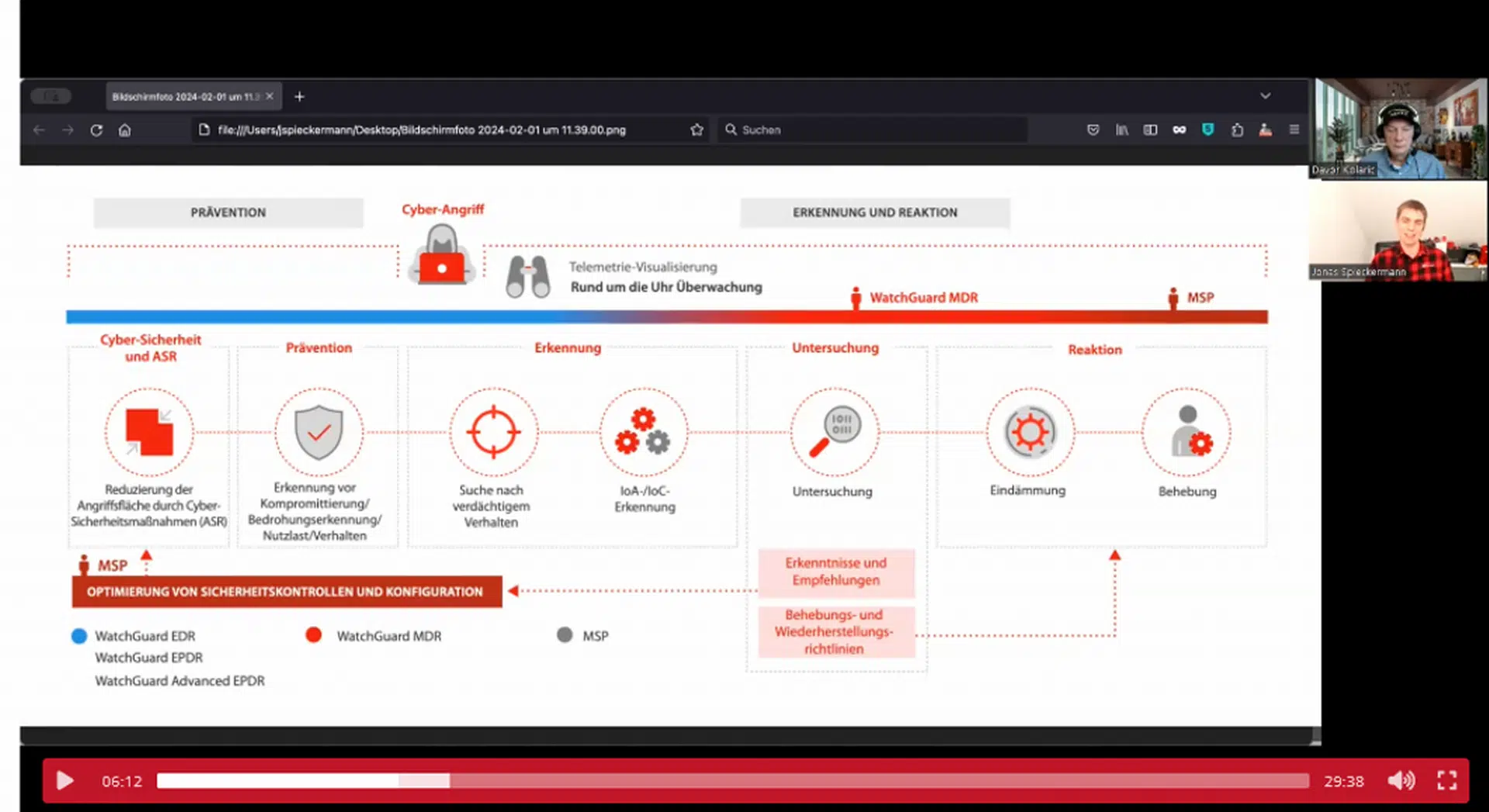

WatchGuard Managed Detection & Response – Erkennung und Reaktion rund um die Uhr ohne Mehraufwand